NVIDIA przyjmuje tranzystory GAA: Huang obiecuje 20% wzrost wydajności

Arkadiy Andrienko

Arkadiy Andrienko

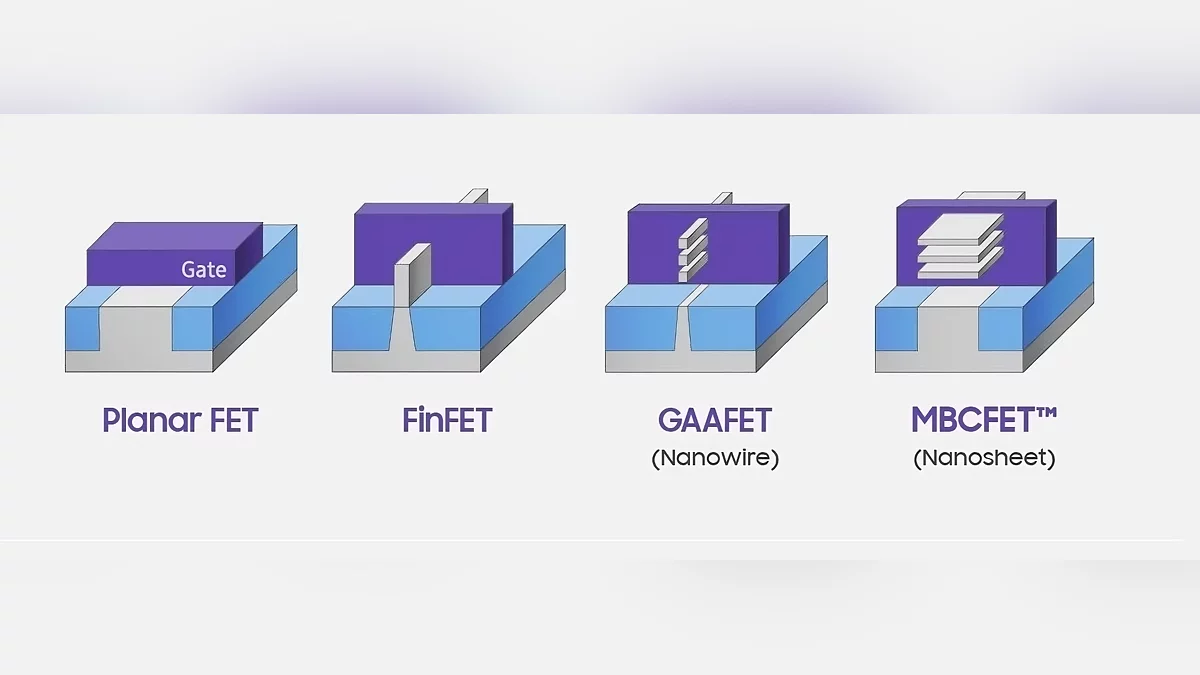

Podczas konferencji GTC 2025 w San Jose, dyrektor generalny NVIDIA, Jensen Huang, ujawnił szczegóły strategii technologicznej firmy, która łączy innowacje w dziedzinie półprzewodników z rozwojem solidnej infrastruktury AI. Według Huanga, przejście na tranzystory gate-all-around (GAA) w nadchodzących chipach Feynman — oczekiwanych do 2028 roku — zwiększy wydajność o nawet 20%. Jednak firma kładzie kluczowy nacisk na rozwiązania architektoniczne i programowe, a nie tylko na wyścig z czasem w przyjmowaniu najnowszych procesów produkcyjnych.

Huang zauważył, że era rewolucyjnych przełomów w litografii dobiega końca. Nawet przejście na obiecujące węzły 2-nm z tranzystorami GAA, według szacunków TSMC, ma przynieść jedynie 10–15% poprawy wydajności. Niemniej jednak, NVIDIA — tradycyjnie ostrożna w kwestii „surowych” technologii — planuje wykorzystać zoptymalizowane wersje, takie jak N2P czy A16 z odwrotnym zasilaniem. Huang wierzy, że takie podejście osiągnie deklarowany 20% wzrost, redukując opór i stabilizując zużycie energii.

Huang jasno stwierdził, że NVIDIA nie postrzega się już jako tradycyjny producent półprzewodników. Zamiast tego, firma buduje kompleksową infrastrukturę AI, która obejmuje algorytmy do wizji komputerowej, robotyki, a nawet projektowania chipów. Przykładem tej strategii są nadchodzące platformy Rubin (zaplanowane na 2026 rok) w procesie 3-nm N3P, które zintegrować mają GPU Vera i CPU w jedną architekturę dla centrów danych. Jednak, jak zauważa Huang, ich pełny potencjał zostanie zrealizowany dopiero w połączeniu z własnymi frameworkami, takimi jak CUDA i Omniverse.

Entuzjazm wokół technologii GAA jest uzasadniony, ponieważ te tranzystory rzeczywiście mogą dostarczyć wzrost wydajności. W tranzystorach GAA bramka całkowicie otacza kanał przewodzący, minimalizując wycieki i poprawiając kontrolę. Analitycy zauważają, że wypowiedzi Huanga odzwierciedlają szerszy trend w branży: przesunięcie uwagi z samego zwiększania częstotliwości zegara na optymalizację efektywności energetycznej i skalowalności. Wraz z rozwojem klastrów AI, nawet 20% wzrost wydajności na poziomie chipów może potencjalnie podwoić wydajność centrów danych — pod warunkiem, że integracja zostanie przeprowadzona w sposób przemyślany.